Готовить релизы без стресса помогает дисциплинированный релиз менеджмент: заранее зафиксировать критерии готовности, выпускать изменения малыми порциями через канареечный деплой, держать наблюдаемость и заранее отрепетированный rollback. На практике это сводится к одному: автоматизированный пайплайн, прозрачные стоп‑сигналы и понятный план действий при деградации.

Главные принципы безстрессового релиза

- Релиз - это процесс с входными критериями (готовность) и выходными критериями (стабильность), а не "кнопка деплой".

- Делайте изменения маленькими: меньше дифф - проще диагностика и быстрее откат.

- Используйте стратегии деплоя, где риск контролируется трафиком (канарейка, поэтапное включение, фичефлаги).

- Никаких ручных "правок на проде": только через CI/CD, версии и аудит.

- Наблюдаемость важнее логов: метрики/алерты должны ловить деградацию быстрее, чем пользователи.

- Rollback в devops - заранее подготовленный сценарий, а не импровизация при панике.

План релиза и критерии готовности

Подходит командам, где релизы регулярные и есть минимум автоматизации: сборка, тесты, деплой. Особенно полезно, когда есть несколько сервисов/компонентов и важно не ловить регрессии на пользователей.

Не стоит делать релиз по "быстрому плану", если вы не можете быстро восстановиться: нет версионирования, нет артефактов, нет доступа к логам/метрикам, отсутствует возможность откатить схему данных или выключить фичу флагом.

Минимальные критерии готовности (Definition of Ready для релиза)

- Зафиксирован релизный кандидат: тег/коммит, артефакт, чейнджлог.

- Есть список изменений и ожидаемое влияние (какие эндпоинты/фичи/таблицы затронуты).

- Есть план развертывания и план отката (включая ответственных и окна времени).

- Пройдены автоматические проверки: линтеры, тесты, скан уязвимостей (что у вас уже принято).

- Настроены метрики и алерты на ключевые SLI (ошибки, задержки, насыщение ресурсов).

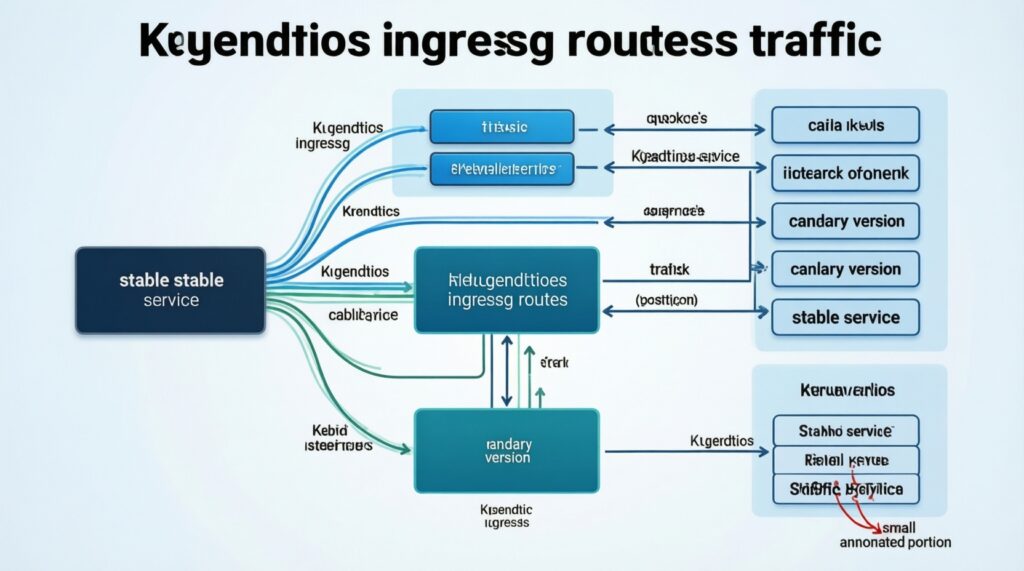

Стратегии деплоя: канареечные подходы и их вариации

Для управляемого управления релизами вам понадобятся: доступ к балансировщику/ingress (или сервис-меш), возможность маршрутизации по весам/заголовкам, наблюдаемость (метрики+логи+трейсы), версионирование артефактов и механизм быстрого выключения функционала (фичефлаги/конфиги).

Что нужно подготовить заранее

- Маршрутизация трафика: NGINX Ingress, Envoy, Istio/Linkerd или L7‑балансировщик с весами.

- Две версии одновременно (stable и canary): отдельные Deployment/ReplicaSet, разные метки/сервисы.

- Фичефлаги для рискованных изменений, чтобы отделить "деплой кода" от "включения функции".

- Набор SLI/алертов, по которым вы решаете "продолжаем раскатку" или "стоп".

- Права: кто может менять веса трафика, кто может инициировать откат, кто ставит релиз на паузу.

Практические варианты

- Канареечный деплой по весам: 1-5% трафика на canary, затем ступенчато увеличивать при стабильных метриках.

- Канарейка по заголовку/куке: направлять только внутренние аккаунты/QA, чтобы ловить проблемы без влияния на всех.

- Blue/Green: две идентичные среды, переключение трафика одним действием. Хорошо, когда нужно быстро откатываться.

- Rolling update + фичефлаги: технически раскатываем постепенно, функционально включаем по флагу после проверки.

Пример: весовой канареечный трафик на NGINX Ingress

# Идея: stable Ingress обслуживает 100%, canary подключается аннотациями.

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: app-canary

annotations:

nginx.ingress.kubernetes.io/canary: "true"

nginx.ingress.kubernetes.io/canary-weight: "5"

spec:

rules:

- host: app.example.com

http:

paths:

- path: /

pathType: Prefix

backend:

service:

name: app-canary-svc

port:

number: 80

Автоматизация CI/CD и надёжные пайплайны

-

Зафиксируйте единый артефакт релиза. Собирайте образ/пакет один раз и продвигайте его по средам; не пересобирайте "в прод". Это снижает расхождения и упрощает диагностику.

- Тегируйте:

app:1.2.3+ привязка к commit SHA. - Храните SBOM/скан-отчет рядом с артефактом, если у вас это принято.

- Тегируйте:

-

Сделайте проверки блокирующими. Пайплайн должен останавливать релиз при провале критичных тестов, миграций, линтеров или политик безопасности. Ручные исключения - только через явное решение и запись.

- Минимум: unit + smoke + контрактные тесты (если есть).

- Отдельно: проверка конфигов/манифестов (lint/validate).

-

Добавьте этап миграций с безопасными правилами. Для БД используйте backward‑compatible подход: сначала расширяющие изменения (add column), затем код, затем удаление старого - в отдельном релизе.

- Если миграции долгие - делайте их вне окна пиковых нагрузок.

- Если миграции необратимы - обязательны фичефлаги и план деградации.

-

Реализуйте поэтапную раскатку (canary → расширение → 100%). Пайплайн должен уметь: выкатить canary, подождать окно наблюдения, проверить SLI, затем увеличить долю.

- Окно наблюдения задайте как стандарт (например, "несколько минут") и держите одинаковым для команды.

- Автоматизируйте "стоп" по алерту, если ваша платформа позволяет.

-

Сделайте откат технической операцией в один шаг. Откат должен быть командой/джобой: вернуть предыдущий тег, обнулить вес canary, выключить фичу флагом, откатить конфиг.

- Kubernetes:

kubectl rollout undo deploy/app(если применимо). - GitOps: revert/rollback на предыдущую ревизию манифестов.

- Kubernetes:

- Зафиксируйте аудит релиза. Автоматически пишите: кто инициировал, какая версия, какие изменения, время начала/окончания, результат проверок, ссылка на дашборд.

Быстрый режим

- Соберите один артефакт, тегируйте версию и продвигайте ее по средам без пересборки.

- Выкатите canary на малую долю трафика и откройте дашборд с ключевыми SLI.

- Если метрики стабильны - увеличивайте долю ступенями; если нет - сразу стоп и откат версии/весов.

- После 100% трафика держите окно наблюдения и закройте релиз только после подтверждения стабильности.

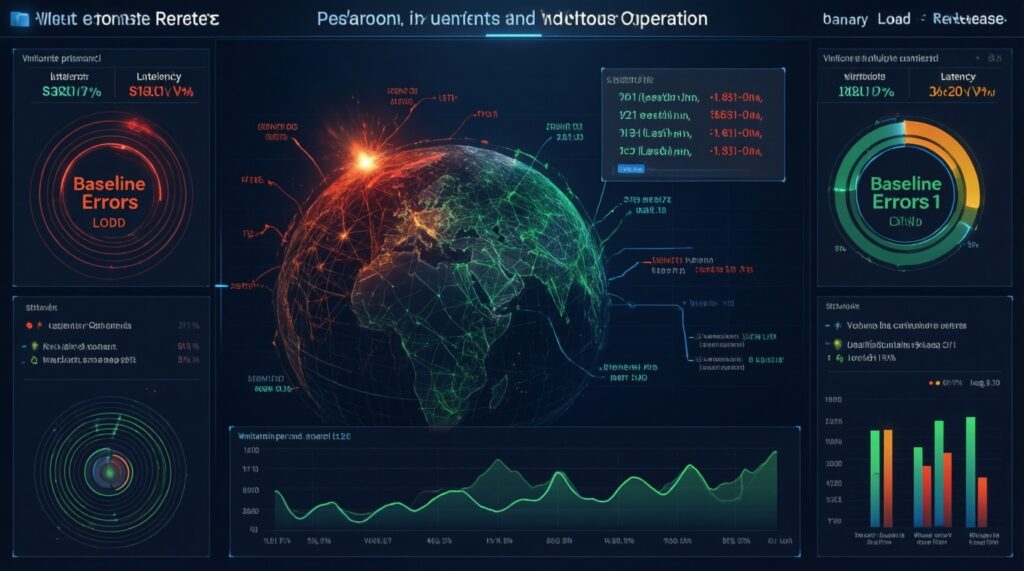

Наблюдаемость: метрики, алерты и аудит релиза

- На старте релиза зафиксированы baseline-значения: ошибки, задержки, нагрузка (хотя бы визуально на дашборде).

- Есть алерты на рост 5xx/ошибок бизнес-операций и на скачок p95/p99 задержек (по вашим SLO/порогам).

- Разделены метрики по версиям (stable vs canary), чтобы канарейка не "пряталась" в общей агрегации.

- Логи коррелируются с запросами (request-id/trace-id), и их можно быстро отфильтровать по версии/подам.

- Трейсинг (если есть) показывает, где именно выросла латентность: БД, очередь, внешний API.

- Есть синтетические проверки (smoke) на критические пользовательские сценарии.

- Есть мониторинг ошибок фронта/клиента, если релиз затрагивает UI.

- Аудит релиза содержит ссылку на сравнение метрик "до/после" и список принятых решений (продолжаем/пауза/откат).

Rollback: подготовка, сценарии и отработка

- Откат только кода без учета данных. Частая ошибка - выкатить миграцию, а потом "просто откатиться" на старую версию, которая не умеет читать новую схему.

- Нет предыдущего артефакта. Если образ перетерт тегом

latestили не хранится в реестре, rollback превращается в пересборку под давлением. - Откат не закрывает трафик на проблемную версию. При канарейке нужно не только откатить Deployment, но и вернуть веса/маршрутизацию на stable.

- Фичефлаги отсутствуют или неуправляемы. Без флага вы вынуждены откатывать весь релиз вместо выключения одной рискованной части.

- Нет четких стоп‑условий. Если команда не договорилась, что именно считается деградацией, релиз затягивается и решения принимаются поздно.

- Rollback не репетировался. Команды знают "теорию", но в инциденте всплывают права доступа, зависимости и забытые ручные шаги.

- Откат конфигов/секретов не синхронизирован. Код откатили, а конфиг остался новый - получаете несовместимость.

- Коммуникация запаздывает. Пока инженеры "пытаются разобраться", поддержка и бизнес не знают статуса и не снижают поток обращений.

Мини-сценарии отката, которые стоит иметь готовыми

- Трафик: вернуть вес canary в 0% или переключить на blue/green обратно на stable.

- Версия: откат Deployment на предыдущий тег/ревизию.

- Функциональность: выключить фичу флагом без отката релиза.

- Данные: план деградации (read-only режим, отключение фоновых джоб) вместо "отката миграции", если она необратима.

Организация коммуникации и руководство на инциденты

Чтобы релиз менеджмент не превращался в чат-хаос, используйте один канал и заранее заданные роли: релиз-координатор (ведет таймлайн), исполнитель (вносит изменения), наблюдатель (следит за метриками), связной (сообщает статус поддержке/бизнесу).

Рабочие альтернативы и когда они уместны

- Release train (релизный поезд): фиксированные окна релизов. Уместно при большом числе команд и зависимости между сервисами - меньше внеплановых релизов.

- Feature flags first: деплой часто, включение функций редко. Уместно, когда много продуктовых экспериментов и нужно снизить риск без торможения поставки.

- GitOps для управления релизами: источник истины - репозиторий манифестов, откат - revert. Уместно, когда важны повторяемость и аудит изменений.

- Ручной change approval только для high-risk: для опасных изменений (миграции, платежи) добавляйте обязательное подтверждение, а для остальных - автоматизацию. Уместно при строгих требованиях комплаенса.

Короткие ответы на типичные сомнения при релизах

Что важнее: канареечный деплой или фичефлаги?

Они решают разные риски: канареечный деплой ограничивает воздействие через трафик, фичефлаги позволяют выключить конкретную функцию без отката всей версии. Вместе это самая практичная связка среди стратегий деплоя.

Как понять, что можно увеличивать долю трафика на канарейку?

Смотрите метрики отдельно по canary: ошибки, задержки, бизнес-события. Если ключевые SLI не ухудшаются в выбранном окне наблюдения - увеличивайте долю ступенчато.

Нужно ли отдельное окно релиза, если деплоим каждый день?

Окно полезно как договоренность по поддержке и наблюдаемости: когда команда гарантированно на связи и готова реагировать. При частых релизах делайте "малые окна" и автоматизируйте проверки.

Какой минимальный набор для rollback в devops?

Предыдущий артефакт, команда/джоба отката, возврат маршрутизации трафика и заранее определенные стоп‑условия. Если есть БД-миграции - нужен план совместимости схемы или фичефлаги.

Можно ли обойтись без трейсов?

Можно, но диагностика деградаций будет дольше. Минимум для надежного управления релизами - метрики + структурированные логи с корреляцией по request-id.

Что делать, если миграция данных занимает долго и мешает откату?

Разбивайте на этапы: расширяющая миграция, совместимый код, перенос данных в фоне, удаление старого позже. Тогда откат версии не ломает чтение/запись.