Наблюдаемость (observability) помогает находить деградации и скрытые сбои до жалоб пользователей, связывая метрики, логи и трассировки с реальными сценариями и SLO. Практика сводится к трём вещам: правильно выбрать сигналы, собрать их в единую модель сервиса и настроить алёрты по симптомам и причинам, а не по сырым событиям.

Ориентиры для оперативной диагностики

- Есть золотые сигналы по каждому критичному API/очереди/воркеру: latency, traffic, errors, saturation.

- Каждый алёрт ведёт к конкретной панели и трассе (из алёрта можно за 1-2 клика открыть контекст).

- Логи структурированы и коррелируются по trace_id/span_id и request_id.

- Определены SLO/SLI для пользовательских путей, а не только для инфраструктуры.

- Для релизов есть минимальный набор проверок наблюдаемости и план отката.

- Инциденты расследуются по одному алгоритму: симптом → срез → корреляция → локализация → причина.

Понимание сигналов: метрики, трейсы и логи в контексте наблюдаемости

- Цель: понимать, какой сигнал использовать для какого вопроса, чтобы ловить проблемы раньше пользователей.

- Критерии готовности:

- Метрики отвечают на "что сломалось и насколько" (тренды, пороги, SLO, ёмкость).

- Трейсы отвечают на "где именно в цепочке" (узкое место, внешний зависимый сервис, конкретный endpoint).

- Логи отвечают на "почему" (контекст исключения, параметры, ветка кода, редкие условия).

- Кому подходит: командам с микросервисами, очередями, несколькими БД, мобильными/веб-клиентами, частыми релизами.

- Когда не стоит начинать "по максимуму":

- Если нет владельцев сервисов и ответственных за SLO: сначала закрепите ownership.

- Если нет базового мониторинга доступности/ошибок: сначала поднимите минимальный слой health + latency + error rate.

- Если вы сейчас выбираете "observability платформа купить" без модели данных и сценариев: риск купить витрину вместо системы.

Проектирование коллекции данных: что измерять и как это связано с бизнес-целями

- Цель: спроектировать набор сигналов так, чтобы он отражал пользовательские пути и бизнес-риски.

- Что понадобится (доступы/требования):

- Карта зависимостей: сервисы, очереди, внешние API, БД, кэши, CDN.

- Список критичных пользовательских сценариев (оплата, поиск, логин, создание заказа) и их SLI (успех/латентность).

- Доступ к CI/CD и конфигурациям окружений (переменные, секреты через vault/secret manager).

- Единый формат идентификаторов корреляции: request_id + trace_id (и правила прокидывания через gateway/async).

- Роли/права: кто может менять алёрты, дашборды, политики ретенции, sampling.

- Критерии готовности:

- Для каждого сценария определён SLO и "бюджет ошибок" как правило принятия релизов/экспериментов.

- Сформирован "минимальный обязательный набор" метрик/логов/трейсов на сервис (а не "логируй всё").

- Есть понимание экономических ограничений: обсуждая "внедрение observability стоимость", вы опираетесь на объёмы данных, ретенцию и sampling, а не на абстрактный "тариф".

Архитектура сбора и хранения: от агентов до OLAP/TSDB

- Цель: собрать сигналы безопасно и предсказуемо по затратам, сохранив возможность расследований.

Мини-чеклист подготовки перед внедрением

- Определите границы: какие окружения собираем (prod, staging), какие данные запрещены (PII/секреты), кто утверждает исключения.

- Выберите точку входа: один "пилотный" сервис с реальным трафиком и известными проблемами.

- Задайте ретенцию и лимиты: сроки хранения метрик/логов/трейсов, целевой sampling на трейсы.

- Согласуйте формат полей: service.name, env, version, region, trace_id, request_id, user_anon_id.

- Подготовьте безопасный канал доставки: TLS, ротация токенов, отдельные ключи на окружения.

-

Определите точки инструментирования

Начните с ingress (gateway/балансер), критичных API и фоновых обработчиков. Для каждого endpoint зафиксируйте метрики R/E/L (rate/errors/latency) и обязательные теги (service, env, route, status).

- Не добавляйте высококардинальные лейблы (например, raw user_id) в метрики.

- В логах допускайте идентификаторы только в безопасном виде (хеш/обрезка), если это согласовано политиками.

-

Включите распределённую трассировку и корреляцию

Прокиньте trace context через HTTP и асинхронные границы (очереди/шины). Убедитесь, что логи пишут trace_id/span_id, чтобы из ошибки в логе можно было открыть конкретный трейс.

Пример (идея, не привязана к вендору):

export OTEL_SERVICE_NAME=billing-api export OTEL_TRACES_SAMPLER=parentbased_traceidratio export OTEL_TRACES_SAMPLER_ARG=0.1 -

Разведите хранилища по типам нагрузки

Метрики удобнее хранить в TSDB, логи - в поисковом/колоночном хранилище, трейсы - в специализированном хранилище или в колонке с индексацией по trace_id. Это снижает стоимость запросов и ускоряет расследования.

- Сразу задайте ретенцию и downsampling/rollup для метрик.

- Для логов определите уровни (INFO/WARN/ERROR) и хранение по важности.

-

Настройте сбор: агенты/коллекторы/шлюзы

Разместите коллектор ближе к ворклоадам (DaemonSet/sidecar/agent) и отправляйте данные в централизованный backend. Задайте буферы и backpressure, чтобы телеметрия не "клала" сервис при проблемах сети.

Мини-пример проверки доступности приёмника:

curl -sf https://collector.example.local/health || exit 1 -

Включите контроль качества данных (data quality)

Добавьте дашборды на пропуски данных: падение объёма метрик/логов, рост dropped spans, рост ошибок экспорта. Без этого вы рискуете "ослепнуть" и узнать о проблеме последними.

- Алёрт на "нет данных" должен быть отдельным и приоритетным.

- Версионируйте схемы логов и наборы метрик, чтобы изменения в релизах были наблюдаемыми.

-

Продумайте модель затрат до покупки

Перед тем как решать "APM мониторинг купить" или "логирование трассировка метрики платформа купить", оцените драйверы затрат: объём логов, доля трейсов (sampling), кардинальность меток, ретенция и частота запросов командой.

- Если обсуждается "мониторинг и наблюдаемость сервисов цена", фиксируйте допущения (ретенция, sampling, лимиты) как часть архитектуры, а не как устную договорённость.

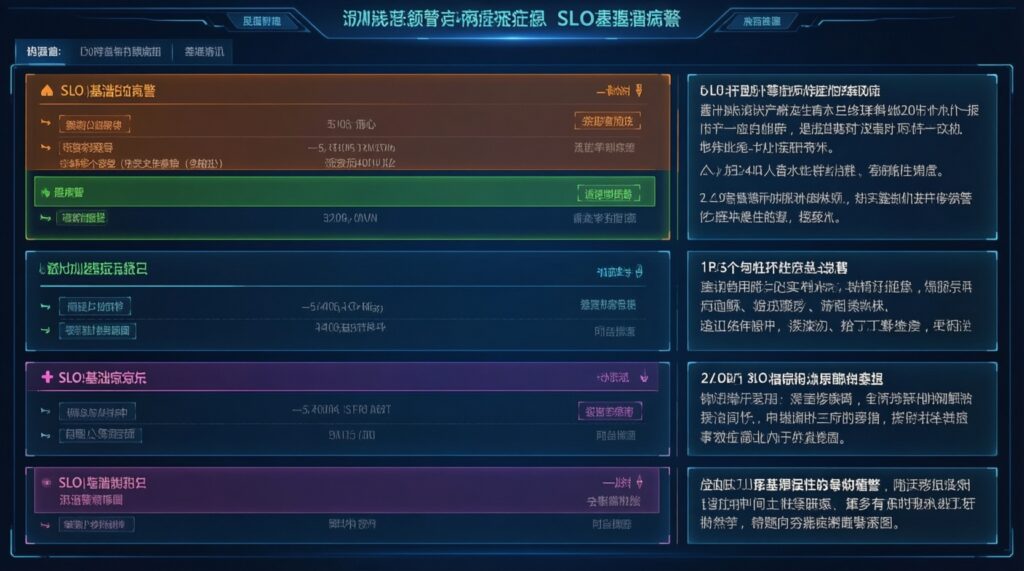

Настройка алёртинга: правила, пороги и борьба с шумом

- Проверка результата (чек-лист):

- Алёрты привязаны к SLO/пользовательскому эффекту (ошибки, latency, недоступность), а не к единичным исключениям.

- Есть разделение на: симптом (SLO burn/ошибки) и причину (очередь растёт, БД тормозит, внешняя зависимость 5xx).

- Для каждого алёрта задана ожидаемая реакция: кто дежурит, какой runbook, какой "порог эскалации".

- Используются окна и устойчивые условия (например, N минут подряд), чтобы не ловить краткие пики.

- Снижена кардинальность уведомлений: один инцидент - один алёрт, группировка по service/env/region.

- Настроены исключения на плановые работы и деплои (maintenance windows), но не "вечно выключенные" правила.

- Есть алёрты на деградацию телеметрии (no data, exporter errors, dropped spans).

- Пороговые значения пересматриваются по факту (postmortem обновляет правила, а не только описание).

Проверки готовности наблюдаемости перед релизом

- Частые ошибки, которые нужно отловить до выката:

- Новые endpoints вышли без метрик R/E/L и без дашборда на сервисный уровень.

- Логи перестали быть структурированными (поменяли формат, пропали поля trace_id/request_id).

- В метрики добавили высококардинальные лейблы (память/стоимость растут, запросы тормозят).

- Sampling трейсов слишком агрессивный для дебага (нет полных цепочек на ошибки).

- Алёрты срабатывают на деплой (нет фильтра по версии/окну прогрева, нет "deployment annotation" на графиках).

- Нет проверки "no data": после релиза агент/коллектор упал, а алёртов нет.

- Секреты/PII случайно попали в логи (нет маскирования/политик, нет ревью логирования).

- Runbook отсутствует или устарел (алёрт есть, но непонятно, что делать и где смотреть).

- Дашборды показывают "в среднем по больнице", нет разрезов по region/az/tenant (в пределах допустимой кардинальности).

Алгоритм расследования инцидента: быстрый путь от симптома к корню

- Вариант 1 - SLO-first (когда есть SLO и burn-rate): начните с алёрта по SLO, определите затронутый сценарий, затем через дашборд сервиса откройте трейсы на проблемный route и найдите самый "дорогой" спан.

- Вариант 2 - Trace-first (когда проблема "внутри цепочки"): фильтруйте трейсы по error=true или по высокой latency, группируйте по корневому span.name/route и сравнивайте успешные vs проблемные цепочки.

- Вариант 3 - Log-first (когда есть явные ошибки/эксепшены): найдите сигнатуру ошибки в логах, возьмите trace_id/request_id и восстановите контекст через трейс и метрики (пики ошибок, saturation, очереди).

- Вариант 4 - Dependency-first (когда подозрение на внешнюю систему): проверьте метрики зависимостей (5xx/timeout/latency), затем сравните по регионам и версиям; на своей стороне ищите ретраи, таймауты и рост очередей.

Типичные ошибки внедрения и практические решения

Почему алёрты "шумят" и их начинают игнорировать?

Обычно алёрт завязан на единичное событие или слишком короткое окно. Переведите правила на SLO/симптомы, добавьте группировку и устойчивые условия (несколько минут подряд), отделите симптом от причины.

Почему нельзя просто логировать всё, чтобы точно найти проблему?

Объём и стоимость растут, а найти нужное становится сложнее. Введите структурированные логи, уровни важности, маскирование, и оставьте подробные DEBUG только временно и точечно.

Что делать, если после релиза "пропали метрики/трейсы", но сервис жив?

Добавьте алёрты на no data и ошибки экспорта, а в пайплайн релиза - проверку доступности коллектора/агента. Проверьте права, сетевые политики и лимиты буферов у коллектора.

Почему трассировка не помогает: трейсы "рваные" и нет связи между сервисами?

Обычно не прокинут trace context через gateway или асинхронные границы. Включите propagation стандартного контекста, прокидывайте trace_id в сообщения очередей и убедитесь, что логи коррелируются по trace_id.

Как обсуждать закупку платформы, если бизнес просит цифры и "внедрение observability стоимость"?

Сведите разговор к драйверам затрат: ретенция, sampling трейсов, объём логов, кардинальность меток и число активных пользователей системы. Так вопрос "observability платформа купить" превращается в управляемый проект с лимитами.

Почему дашборды есть, а проблемы всё равно видят пользователи?

Панели показывают инфраструктуру, а не пользовательские пути. Постройте SLI по ключевым сценариям и алёрты по деградации качества, а не по загрузке CPU.