Управление релизами в продакшне проще и безопаснее, если заранее выбрать стратегию: feature flags для поэтапного включения функциональности, canary deployment для проверки на малой доле трафика и blue green deployment для почти мгновенного переключения между средами. Ниже - практическая инструкция, метрики и пороги, типовые ошибки и кейсы.

Краткая карта стратегий релизов

- Feature flags выбирайте, когда нужно включать функции по сегментам пользователей и быстро отключать без отката артефакта.

- Canary deployment используйте, когда важна проверка реальных метрик на части трафика и есть наблюдаемость (метрики, логи, трассировки).

- Blue green deployment подходит, когда нужен быстрый свитч и предсказуемый откат, а миграции данных контролируемы.

- Всегда закладывайте откат: план технического отката и план функционального отката (флаги, деградация).

- Автоматизируйте гейты в CI/CD: релиз без проверок SLO и алертов почти гарантирует ночные инциденты.

Когда и зачем вводить feature flags: практическая инструкция

Feature flags внедрение оправдано, когда релиз нужен часто, а включение функций должно быть управляемым: по пользователям, по рынкам, по ролям, по проценту трафика. Это снижает риск, ускоряет эксперименты и помогает отделить выкладку кода от активации поведения.

Кому подходит

- Командам с регулярными релизами и несколькими параллельными фичами.

- Продуктам с A/B-тестами, постепенными раскатками, разными конфигурациями по клиентам.

- Сервисам, где нужно "мягкое" отключение проблемной функции без полного отката версии.

Когда лучше не делать (или делать минимально)

- Нет дисциплины удаления флагов: технический долг растёт быстрее пользы.

- Слабая наблюдаемость: вы не увидите, что флаг ухудшил SLO.

- Сложные транзакции и консистентность: флаг меняет поведение посреди бизнес-процесса и ломает инварианты.

Практический минимум для внедрения

- Классифицируйте флаги: релизные (короткоживущие), экспериментальные, операционные (для деградации), конфигурационные (долгоживущие).

- Задайте правила жизненного цикла: дата удаления, владелец, критерии включения по умолчанию, обязательный тикет на уборку.

- Сделайте безопасное значение по умолчанию: новый код за флагом не должен активироваться случайно при сбое хранилища флагов.

- Добавьте аудит: кто и когда менял флаг, с возможностью быстрого отката значения.

- Свяжите флаги с метриками: минимум - ошибки, латентность, бизнес-метрика (конверсия/успех операции) в разрезе состояния флага.

Канареечные релизы: настройка, метрики и пороговые значения

Canary deployment настройка требует не только маршрутизации трафика, но и чётких критериев остановки. Цель - ограничить blast radius и принимать решение по данным, а не по ощущениям.

Что понадобится (доступы, инструменты, подготовка)

- Маршрутизация трафика: ingress/service mesh/балансировщик с поддержкой весов или маршрутов по заголовкам/кукам.

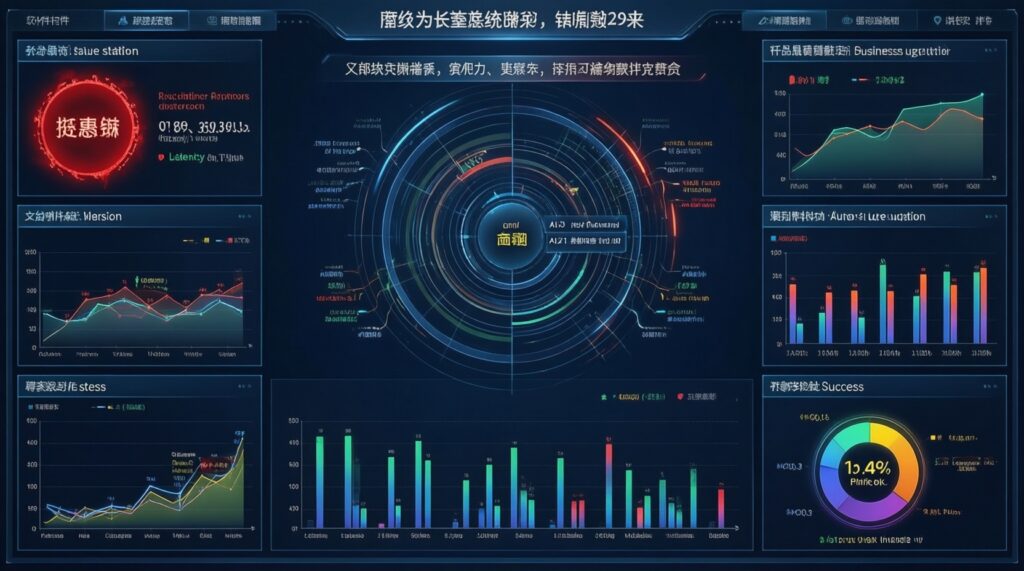

- Наблюдаемость: метрики (RED/USE), централизованные логи, трассировки, дешборды и алерты, корреляция по версии/подам.

- Идентификация версии: label/annotation версии в инфраструктуре + прокидывание версии в логи/трейсы.

- Автоматизированные проверки: smoke-тесты, синтетика, health-checks (readiness/liveness), желательно - контракты и e2e на критических флоу.

- Контроль миграций: совместимость схемы (forward/backward), запрет разрушительных миграций в канареечном окне.

Метрики и практичные пороги (ориентиры)

- Ошибки: рост доли 5xx/ошибок приложения в канареечном сегменте относительно базовой версии - повод остановиться.

- Латентность: увеличение p95/p99 на ключевых ручках относительно контрольной группы - сигнал риска; порог задавайте как допустимую дельту к текущему SLO.

- Насыщение: рост CPU throttling, OOM, насыщение пула соединений, очередей.

- Бизнес-метрика: падение доли успешных транзакций/оплат/созданий сущностей в канареечном сегменте.

- Качество данных: рост доли ретраев, дедупликаций, компенсирующих операций.

Типовой сценарий раскатки

- Старт: 1-5% трафика на канарейку, только после успешных smoke и readiness.

- Наблюдение: фиксированное окно наблюдения, одинаковое для каждой ступени (чтобы сравнение было честным).

- Расширение: ступенчатое увеличение веса (например, 10% → 25% → 50% → 100%) только при прохождении гейтов.

- Откат: автоматический или ручной, если сработал стоп-критерий; обязательно - фиксация артефактов (логи, трейсы, diff конфигов).

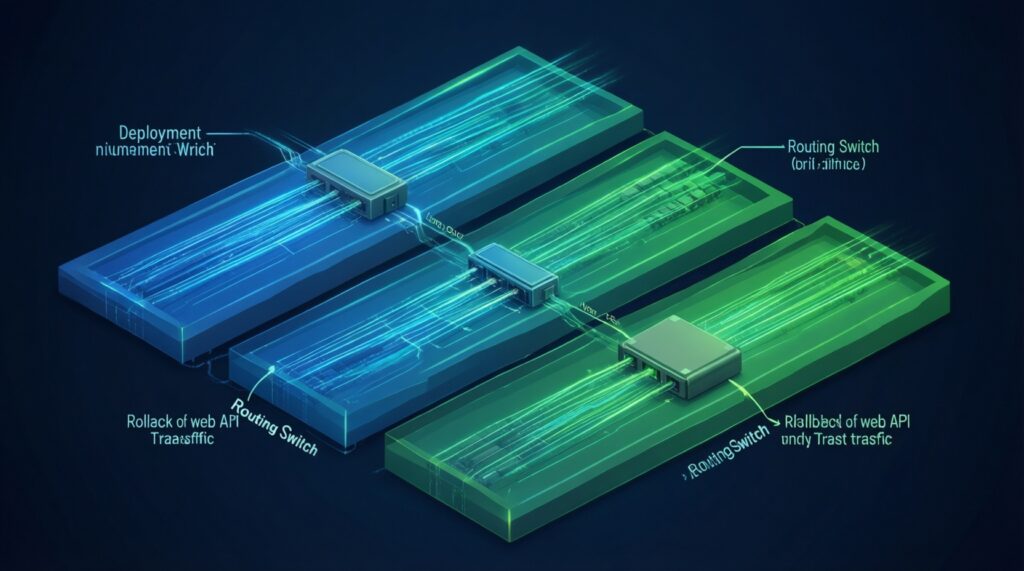

Blue‑Green deployment: архитектура, переключение и откат

Blue green deployment держит две полноценные среды: текущую (Blue) и новую (Green). Переключение выполняется на уровне маршрутизации, а откат - возвратом трафика назад. Это удобно для web/API, но требует дисциплины по данным, сессиям и фоновым задачам.

Риски и ограничения, которые нужно признать до начала

- Миграции БД могут сделать откат невозможным: любые back-incompatible изменения ломают возврат на Blue.

- Сессии и кэш: липкие сессии, разные ключи кэша, несовместимые форматы могут вызвать массовые logout/ошибки.

- Фоновые воркеры: два окружения могут одновременно обрабатывать одни и те же задания или события.

- Стоимость: две среды означают двойные ресурсы на время релиза и прогрева.

- Конфигурационный дрейф: Blue и Green обязаны быть идентичны по инфраструктуре, кроме версии приложения.

-

Подготовьте две изолированные среды Blue и Green

Инфраструктура должна быть максимально одинаковой: конфиги, секреты, лимиты, зависимости. Отличаться должна только версия приложения и, при необходимости, фичи за флагами.

- Зафиксируйте инфраструктуру как код и снимите дифф перед релизом.

- Проверьте, что мониторинг различает Blue и Green по меткам.

-

Разверните Green и прогрейте

Поднимите Green до полного масштаба, выполните миграции в безопасном режиме и прогрейте кэш/компиляцию, чтобы избежать холодных пиков после свитча.

- Сделайте smoke-тесты, синтетику и критические e2e до переключения трафика.

- Проверьте фоновые джобы: либо выключите их на Blue, либо включайте по флагу/лидер-выбору.

-

Выполните переключение трафика на Green

Свитч делайте атомарно на уровне балансировщика/ingress/DNS, с заранее согласованным окном и наблюдением метрик в реальном времени.

- Если используете DNS, учитывайте TTL и кеширование - это ухудшает предсказуемость отката.

- Сохраняйте возможность быстрым действием вернуть маршрутизацию на Blue.

-

Проведите пост‑свитч валидацию

Проверьте SLO, алерты, ключевые бизнес-флоу и поведение интеграций. Если что-то пошло не так - откатывайтесь сразу, не пытаясь "починить на лету" под нагрузкой.

- Сверьте метрики ошибок и латентности с baseline до релиза.

- Проверьте очереди, ретраи, скорость обработки событий.

-

Откат (если нужен) и закрытие релиза

Откат - это возврат трафика на Blue плюс быстрые действия по стабилизации данных/очередей. После успешного окна наблюдения можно либо удалить Blue, либо держать его до следующего релиза.

- Если миграции были потенциально необратимыми, заранее подготовьте план компенсации.

- Зафиксируйте, какие флаги и конфиги менялись во время релиза.

Оркестрация релизов в CI/CD: автоматизация и пошаговые сценарии

Для стабильного управления релизами важно, чтобы пайплайн был не просто сборкой и деплоем, а оркестратором: запускает стратегии (флаги/канарейка/blue-green), ставит гейты, снимает телеметрию и умеет останавливать раскатку. Обычно это завязано на вашу платформу для управления релизами (внутреннюю или внешнюю) и политики доступа.

Проверка результата после выкладки: чек‑лист

- Сборка и артефакт неизменяемы: один и тот же образ/пакет проходит dev → stage → prod.

- Readiness/liveness зелёные, нет restart loop, нет всплеска OOM/CPU throttling.

- Сравнение ошибок и латентности (p95/p99) с baseline до релиза на ключевых ручках.

- Алерты настроены на пользовательские симптомы (ошибки/латентность/успех транзакций), а не только на инфраструктуру.

- Логи и трассировки содержат версию, окружение и ключевые бизнес-идентификаторы (без утечек персональных данных).

- Состояние очередей и ретраев под контролем: нет бесконечного роста backlog.

- Фичи за флагами включаются только после прохождения гейтов, изменение флага логируется.

- План отката проверен: команды знают, что именно переключать (трафик, флаг, версию), и у кого есть доступ.

Управление рисками и контроль качества в продакшне

Большинство инцидентов связаны не с выбором стратегии, а с нарушением базовых предпосылок: наблюдаемости, обратимости и управляемой сложности. Ниже - типовые ошибки, которые ломают и canary, и blue-green, и флаги.

- Нет стоп-критериев: раскатка продолжается несмотря на ухудшение метрик, потому что не определены условия остановки.

- Флаги без владельцев: feature flags остаются навсегда, ветвят код, усложняют тестирование и увеличивают риск регрессий.

- Несовместимые миграции: релиз делает схему необратимой, и откат превращается в ручную операцию на данных.

- Отсутствие сегментации метрик: вы не видите разницу между канареечным трафиком и основным.

- Дрейф конфигураций: Green отличается от Blue не только версией; результат релиза становится непредсказуемым.

- Фоновые задачи запускаются в двух средах: дублирование обработок, гонки, повторные списания/уведомления.

- Секреты и права доступа: на Green не хватает прав или секретов, ошибки появляются только после свитча.

- Откат без контроля побочных эффектов: трафик вернули, но очереди/кэш/данные остались в состоянии, несовместимом со старой версией.

| Стратегия | Сильные стороны | Слабые места | Уровень риска при дисциплине |

|---|---|---|---|

| Feature flags | Быстрое включение/выключение поведения, сегментация, можно без redeploy | Технический долг, сложность тестирования, риск непредсказуемых комбинаций | Низкий-средний |

| Canary deployment | Проверка на реальном трафике, ограничение blast radius, измеримые гейты | Требует сильной наблюдаемости и корректной сегментации метрик | Средний |

| Blue green deployment | Быстрый свитч, простой откат трафика, предсказуемая операционная процедура | Сложные миграции БД, стоимость двух сред, риск дублей фоновых задач | Средний-высокий |

Реальные кейсы: ошибки, решения и извлечённые уроки

Кейс 1: Фича включилась всем сразу из‑за сбоя хранилища флагов

Предпосылки: флаг хранился во внешнем сервисе, а код трактовал недоступность как значение по умолчанию включено.

Решение: изменить дефолт на безопасный (выключено), добавить локальный кеш с TTL и явный алерт на недоступность флагов.

Результат: при повторных сбоях включение не происходило, а команда получала сигнал до воздействия на пользователей.

Кейс 2: Канарейка была, но метрики не отличались от основного трафика

Предпосылки: трафик делили по весам, но метрики агрегировались без разреза по версии; проблема проявлялась только на новой сборке.

Решение: добавить label версии в метрики/логи/трейсы, собрать дешборды с сравнением канарейки и baseline, включить стоп‑гейт в пайплайн.

Результат: canary deployment стал управляемым: регрессии ловились на ранней ступени без раскатки на всех.

Кейс 3: Blue‑Green свитч прошёл, но фоновые воркеры удвоили обработку

Предпосылки: и Blue, и Green одновременно читали одну очередь; после переключения Blue не был остановлен, произошли дубли операций.

Решение: выделить воркеры в отдельный deployment и включать их только в активной среде (или через лидер‑элекцию), добавить дедупликацию по idempotency‑key.

Результат: переключения стали безопаснее, а повторная доставка событий перестала приводить к побочным эффектам.

Когда выбирать альтернативы (и какие)

- Rolling update: уместен для статeless сервисов с хорошей обратной совместимостью и коротким временем запуска, когда не хочется держать две среды.

- Shadow traffic: когда нужна проверка логики на прод‑запросах без влияния на ответы пользователям (с обязательной фильтрацией чувствительных данных).

- Ring-based rollout: если продукт географически распределён или есть крупные клиенты - раскатывайте по кольцам (внутренние пользователи → часть регионов → все).

Частые эксплуатационные нюансы и быстрые ответы

Можно ли совмещать feature flags и канареечные релизы?

Да: канарейка проверяет новую сборку, а флаги позволяют включать рискованные части функциональности поэтапно. Важно не смешивать слишком много флагов в одной канареечной итерации, иначе диагностика усложняется.

Что быстрее откатывать: трафик (blue-green) или флаг?

Флаг обычно быстрее и безопаснее для поведения, если проблема в конкретной функции. Если проблема в инфраструктуре/зависимостях или затрагивает базовую совместимость, быстрее и надёжнее откатить трафик на Blue.

Какой минимальный набор метрик нужен для canary deployment?

Ошибки, латентность и насыщение по ключевым компонентам плюс одна бизнес-метрика успеха операции. Все метрики должны быть размечены по версии, иначе гейты будут слепыми.

Что делать с миграциями БД при blue green deployment?

Используйте forward/backward совместимость: сначала безопасные изменения схемы, потом код, затем уборка. Разрушительные миграции выполняйте отдельно, когда откат на старую версию уже не требуется.

Как не утонуть в количестве фичефлагов?

Задайте SLA на удаление релизных флагов и автоматизируйте напоминания. Храните владельца и дату удаления рядом с определением флага, а не в памяти команды.

Нужна ли отдельная платформа для управления релизами?

Если релизы частые и стратегий несколько, платформа для управления релизами окупается: единые политики, аудит, гейты и интеграции. Если релизы редкие, можно начать с возможностей CI/CD и простого сервиса флагов, но с чёткими правилами доступа.